简要介绍

由 CenterNet 发展而来的 3 D 目标检测的 Anchor-free 方法,该文二作是 CenterNet 一作

核心问题 轴对其的 2 D 框无法很好的替代,自由状态的 3 D 目标。一种解决方案是为每个目标朝向分类不同的模板(锚框),这回增加计算负担,并引入大量潜在假阳性检测(锚框 IoU 高,但是类别错误)。作者认为,连接 2 D 和 3 D 的主要潜在挑战在于这种表示方式(预设锚框)

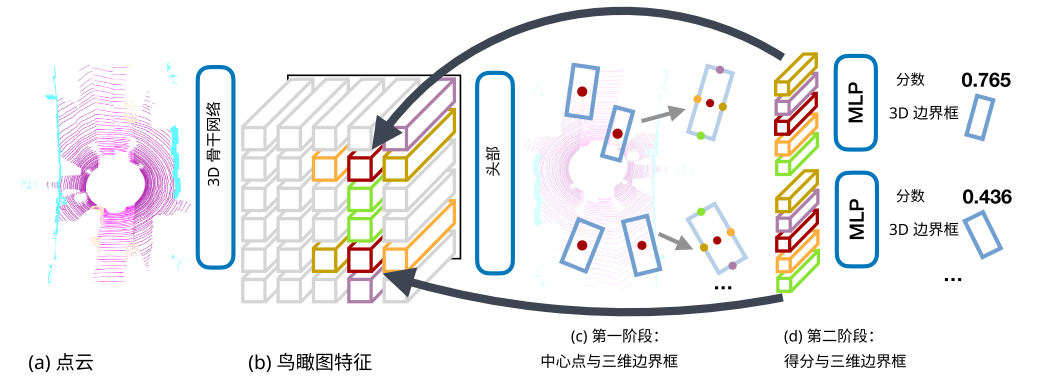

CenterPoint检测器 先使用关键点检测器检测目标中心及其属性,然后通过第二阶段对所有估计结果进行优化。

具体,使用基于激光雷达的标准骨干网络(VoxelNet 或 PointPillars)构建输入点云的特征表示,随后将特征表示转换为俯视地图视角,使用基于图像的标准关键点检测器定位目标中心

对每一个检测到的中心,利用中心位置的点特征回归到其他所有目标属性,如三维尺寸、朝向和速度。

此外,引入轻量级的第二阶段以优化目标定位。该阶段从估计目标边界框各面的 3 D 中心提取点特征,从而恢复因下采样和感受野有限而丢失的局部几何信息,并以较小的计算成本带来显著的性能提升

该方法的优势

- 与边界框不同,点没有内在方向。显著减小了目标检测器的搜索空间,同时允许骨干网络学习目标的旋转不变性及其相对旋转的旋转等变性。

- 基于中心点的表示简化了跟踪等下游任务。

- 基于点的特征提取,使我们可以设置一个高效的两阶段精修模块,速度远超之前的方法

该方法只设计了检测头,骨干网络可以使用现有的 3 D 骨干网络

CenterPoint

首先 3 D 骨干网络提取出额外的点特征。第一阶段预测中心点和三维边界框。再从预测边界框的每个面的 3 D 中心提取一个点的特征。注意,边界框中心、顶面中心和底面中心在鸟瞰图中均投影到一个点。所以只考虑四个朝外的框面的中心点和物体中心点(此时已经是一个 2 D 平面,鸟瞰图)。对每个点使用双线性插值从骨干网络的鸟瞰图输出中提取特征。

然后把提取的点特征拼接,并使其通过一个MLP。第二阶段在单阶段CenterPoint 预测的基础上,预测一个与类别无关的置信度分数和框优化值

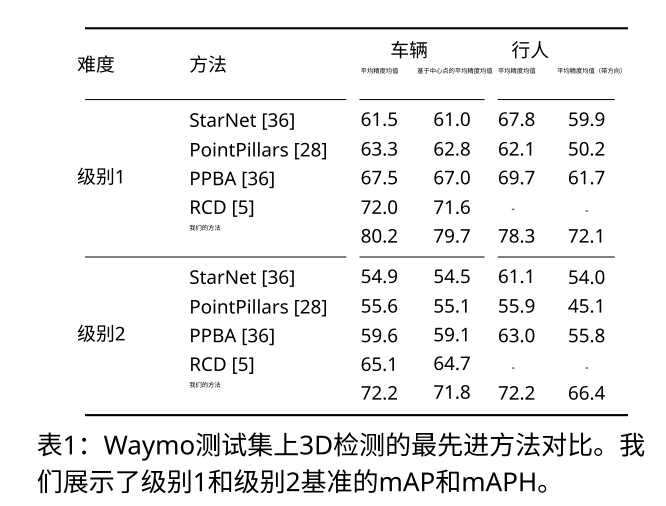

Waymo 数据集

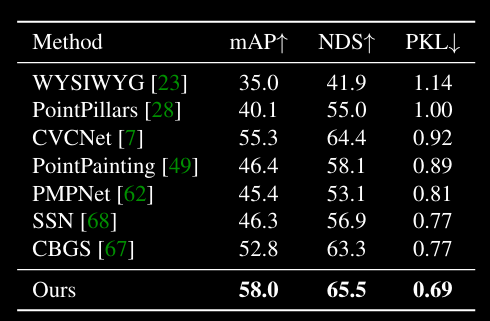

NuScenes 数据集